SK hynix lleva HBM4, DDR5 CXL y almacenamiento OASIS a Supercomputing 2025 para impulsar la memoria de la IA y la HPC

por Manuel NaranjoSupercomputing 2025 (SC25) no ha sido un congreso más de HPC. Este año, la conversación ha girado claramente en torno a la convergencia entre computación de alto rendimiento e inteligencia artificial, y SK hynix ha aprovechado el momento para lanzar un mensaje muy directo: sin una memoria a la altura, toda esa potencia de CPU y GPU se queda a medias.

Bajo el lema “Memoria, impulsando la IA y el futuro”, la compañía ha llevado al evento un catálogo bastante completo de HBM, DRAM para servidor y eSSD pensado específicamente para centros de datos de nueva generación, grandes modelos de IA y simulaciones científicas. Y no se ha quedado ahí: también ha enseñado demos de memoria CXL, sistemas de IA centrados en memoria y almacenamiento computacional OASIS, dejando claro por dónde ve el futuro de la infraestructura de datos.

HBM4 y HBM3E: más canales, más ancho de banda y menos vatios

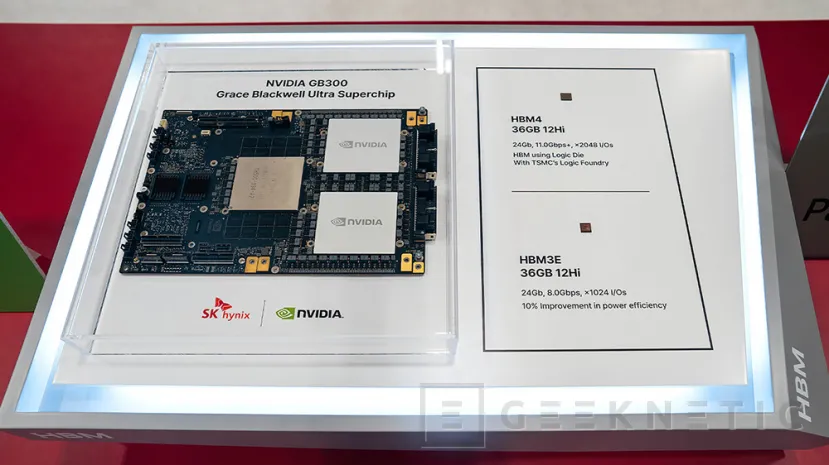

La zona más vistosa estaba reservada a la HBM de última generación. SK hynix ha mostrado su HBM4 de 12 capas, presentada como desarrollo pionero a nivel mundial. La clave no está solo en apilar más, sino en cómo se habla con el resto del sistema: este HBM4 integra 2.048 canales de E/S, el doble que la generación previa, lo que se traduce en un salto muy serio de ancho de banda efectivo.

A eso se suma una mejora de más del 40 % en eficiencia energética, algo que, en un mundo de GPUs que ya rozan o superan los 700 W, marca la diferencia entre un servidor manejable y uno que vive al borde de los límites de su rack.

Junto a HBM4, también estaba presente el HBM3E de 12 capas, que a día de hoy es la solución HBM comercial de mayor rendimiento del mercado y que se está utilizando con GPUs como la Grace Blackwell GB300 de NVIDIA. Es, en la práctica, el puente entre el presente y el futuro inmediato de los aceleradores de IA.

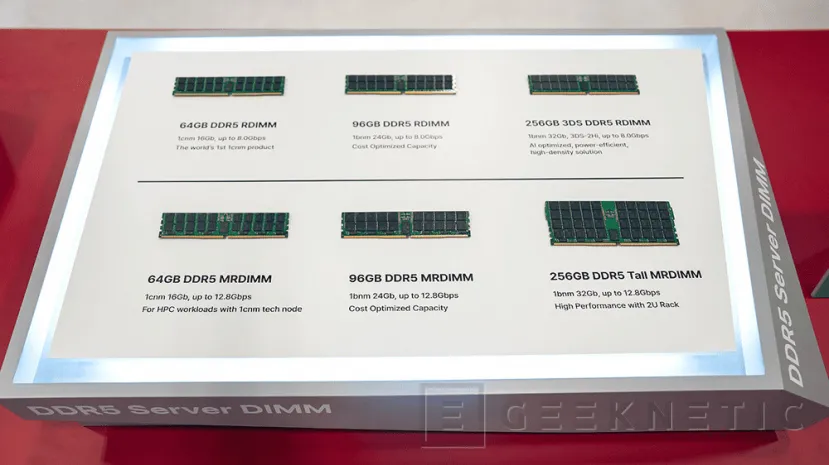

DRAM DDR5 para servidores que no pueden permitirse quedarse sin memoria

La segunda pata de la apuesta de SK hynix pasa por la DRAM para servidor. En SC25 han enseñado módulos basados en DDR5 y nodo 1c, la sexta generación de su proceso de 10 nm. Entre ellos aparecen RDIMM y MRDIMM orientados al mercado de servidores de nueva generación, además de módulos RDIMM DDR5 3DS de 256 GB y MRDIMM DDR5 “Tall” también de 256 GB.

Aquí el objetivo es doble: por un lado, ofrecer más capacidad por zócalo, lo que permite a los operadores de centros de datos escalar la memoria sin tener que multiplicar servidores; por otro, mejorar la velocidad y la eficiencia energética para que los entornos de alto rendimiento mantengan la estabilidad incluso cuando se mezclan cargas de IA, bases de datos masivas y servicios en tiempo real.

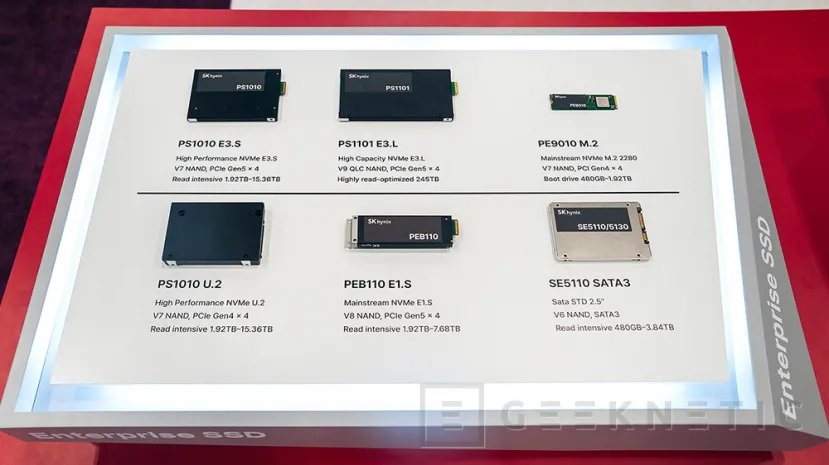

eSSD de alta capacidad: del NAND 4D a la QLC de 321 capas

En almacenamiento sólido, SK hynix se ha llevado prácticamente todo su arsenal. Se han podido ver unidades PS1010 E3.S y PE9010 M.2 basadas en NAND 4D de 176 capas, junto con la PEB110 E1.S que ya sube a NAND de 238 capas. Son soluciones pensadas para servidores que necesitan combinar tamaño, rendimiento y eficiencia energética en formatos cada vez más compactos.

La parte más agresiva, sin embargo, viene de la mano de la NAND QLC. La compañía ha mostrado desde eSSD como la PS1012 U.2 con QLC, hasta la PS1101 E3.L de 245 TB, construida sobre NAND QLC de 321 capas, actualmente la más alta del sector.

Todas estas unidades aprovechan interfaces PCIe 4.0 y 5.0 para ofrecer un throughput acorde a la demanda de los aceleradores actuales.

CXL y memoria heterogénea: más allá del típico “ampliar RAM”

SK hynix también ha mostrado un sistema de memoria heterogénea en colaboración con Montage Technology, donde se combinan un módulo CXL DDR5 (CMM-DDR5) y MRDIMM para demostrar cómo se puede escalar la capacidad de memoria de forma flexible y, además, mejorar el rendimiento global del sistema.

Otra demostración se ha centrado en el CMM-Ax, un acelerador de memoria CXL que integra capacidades de cómputo dentro de la propia memoria.

Además, se ha presentado una máquina de IA “memory-centric” basada en memoria agrupada CXL. En este enfoque, varios servidores y GPUs se conectan a un pool de memoria común, sin necesidad de una red tradicional, para ejecutar tareas de inferencia distribuida sobre modelos de lenguaje grandes (LLM). Es, en cierto modo, un anticipo de cómo podrían ser los clusters de IA cuando CXL madure.

OASIS: cuando el almacenamiento también se pone a calcular

La otra gran pieza de la visión de SK hynix es OASIS (Object Analytics Storage for Intelligent SQL offload), un sistema de almacenamiento de nueva generación basado en CSD (Computational Storage Device) con reconocimiento de datos. Aquí la idea es que el almacenamiento deje de ser un lugar pasivo donde solo se leen y se escriben bloques, y pase a ejecutar parte del trabajo de análisis.

En una ponencia, Soonyeal Yang, líder técnico de Solution SW, ha defendido que los cuellos de botella en los canales de E/S durante el análisis de datos HPC degradan el rendimiento global y aumentan los costes. Su propuesta es precisamente OASIS: un sistema de almacenamiento computacional, interoperable y basado en estándares, que reparte de forma inteligente la carga y ayuda a optimizar la infraestructura sin rediseñarla desde cero.

En un entorno donde los modelos crecen, las bases de datos explotan y los centros de datos buscan desesperadamente más rendimiento por vatio, la memoria pasa de ser un componente más a convertirse en la pieza que marca el ritmo. Y SK hynix, viendo lo que ha enseñado en SC25, tiene bastante claro que quiere ser quien marque ese ritmo en la próxima década.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!