Meta acelera su carrera por la inferencia con cuatro chips MTIA y una hoja de ruta semestral

por Manuel NaranjoLa batalla de la inteligencia artificial ya no se libra solo en modelos, servicios o centros de datos. También se está jugando en el silicio, y Meta acaba de dejar claro que quiere pelear ahí con más ambición. La compañía ha presentado una nueva hoja de ruta para su programa MTIA, las siglas de Meta Training and Inference Accelerator, con cuatro generaciones de chips pensadas para acompañar la expansión de su infraestructura y cubrir mejor una necesidad que no deja de crecer: la inferencia.

Ese matiz importa. Durante mucho tiempo, gran parte de la conversación alrededor de la IA ha girado en torno al entrenamiento de modelos, pero a escala de producto, la inferencia es la fase que se ejecuta cada vez que un sistema responde, clasifica, recomienda o genera una salida para el usuario. Es, en otras palabras, el trabajo continuo y cotidiano que consume recursos de forma masiva en plataformas con miles de millones de interacciones.

Cuatro generaciones de MTIA para acompasar el crecimiento de los centros de datos

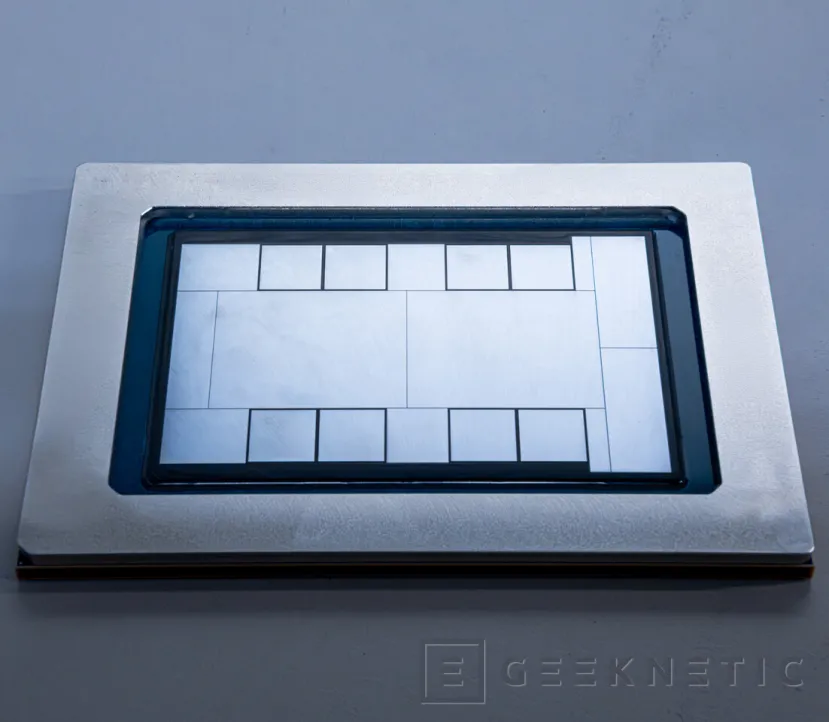

La hoja de ruta presentada incluye los MTIA 300, 400, 450 y 500. El primero ya está en uso para sistemas de ranking y recomendación, mientras que los otros se desplegarán entre este año y 2027. Los dos últimos, MTIA 450 y MTIA 500, están específicamente orientados a cargas de inferencia, lo que muestra un giro bastante nítido en la estrategia.

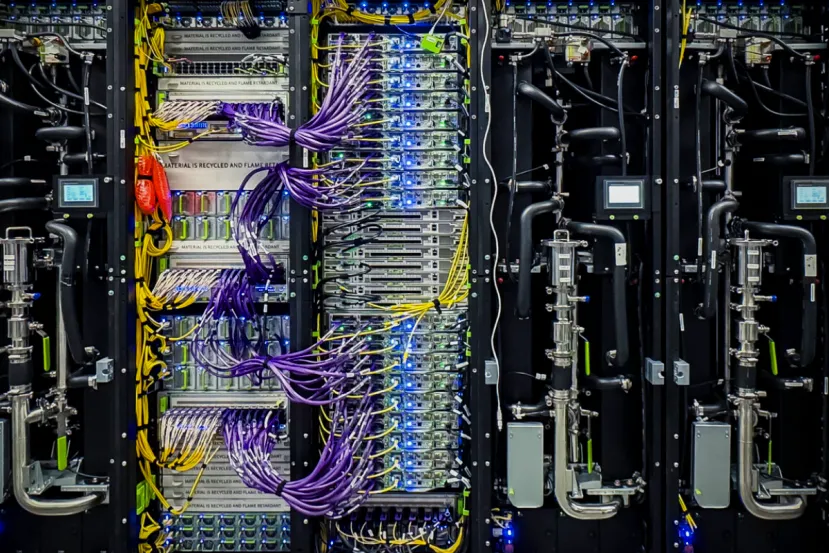

Meta explica además que quiere avanzar a un ritmo de un chip nuevo cada seis meses. En la industria del silicio eso suena agresivo, sobre todo para una compañía cuyo negocio principal no ha sido históricamente vender hardware. Pero la empresa lo vincula a la velocidad a la que está levantando capacidad de centro de datos. Cuanto más rápido se expande la infraestructura, más sentido tiene iterar antes el hardware que la alimenta.

Esa cadencia también apunta a una idea de fondo: Meta no quiere esperar ciclos largos para corregir o adaptar sus aceleradores. En IA, los cuellos de botella cambian rápido, y diseñar chips con un enfoque iterativo permite ir afinando el equilibrio entre ancho de banda, capacidad de memoria, consumo y rendimiento útil según evolucionan los modelos y los servicios.

Menos dependencia de GPU generalistas y más silicio a medida

Uno de los argumentos centrales del anuncio es que un chip diseñado para las cargas concretas de Meta puede reducir costes y mejorar la eficiencia energética frente al uso indiscriminado de hardware generalista. La idea no es nueva, pero cobra más fuerza cuando las grandes tecnológicas están compitiendo por reservar capacidad de NVIDIA y AMD mientras construyen sus propias alternativas internas.

Meta no oculta que seguirá comprando grandes volúmenes de aceleradores externos. De hecho, tiene acuerdos recientes con NVIDIA y AMD. Pero al mismo tiempo subraya que Broadcom participa en algunos elementos del diseño y que la fabricación corre a cargo de TSMC, lo que dibuja un modelo híbrido: diseño propio donde compense, socios externos donde haga falta y GPU de terceros donde siga siendo más práctico.

Según los datos técnicos, entre MTIA 300 y MTIA 500, el ancho de banda HBM se multiplica por 4,5 y la capacidad de cómputo por 25. Los MTIA 450 y 500 elevan mucho la apuesta en memoria de alto ancho de banda, justo uno de los puntos más delicados para la inferencia de transformadores, donde mover datos con rapidez puede ser tan importante como la cifra bruta de FLOPS.

Inferencia, modularidad y una infraestructura pensada para escalar

Otro aspecto relevante es el enfoque de sistema. Meta no se limita a diseñar el chip, sino que a partir de MTIA 400 habla de una plataforma completa alrededor del acelerador, incluyendo bastidores y refrigeración líquida.

La compañía también asegura que MTIA 400, 450 y 500 compartirán chasis, rack e infraestructura de red. Eso simplifica la sustitución de una generación por otra y ayuda a sostener esa prometida cadencia semestral.

En software, el mensaje busca despejar una fricción habitual de los aceleradores propietarios. Meta afirma que su pila funciona de forma nativa con PyTorch, vLLM y Triton, además de soportar herramientas como torch.compile y torch.export, con la idea de que los modelos de producción puedan desplegarse tanto en GPU como en MTIA sin reescrituras específicas. Ese detalle es importante, porque el éxito de un chip interno no depende solo del silicio, sino de lo difícil o fácil que resulte usarlo de verdad.

Lo que deja este anuncio es una fotografía bastante clara del momento que vive el sector. Las grandes plataformas ya no quieren limitarse a comprar capacidad de cómputo al mercado. Quieren diseñar piezas propias para las partes del trabajo donde pueden ahorrar energía, reducir costes y controlar mejor el ritmo de despliegue.

En el caso de Meta, la apuesta se concentra ahora en la inferencia, no tanto porque el entrenamiento haya dejado de importar, sino porque responder a miles de millones de solicitudes en productos reales exige una eficiencia quirúrgica. Cada mejora en ancho de banda, en consumo o en densidad se multiplica cuando se reparte por toda la infraestructura global de la compañía.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!