La JEDEC está finalizando el próximo estándar de memorias SOCAMM2, hasta 9,6 Gb/s de ancho de banda por pin

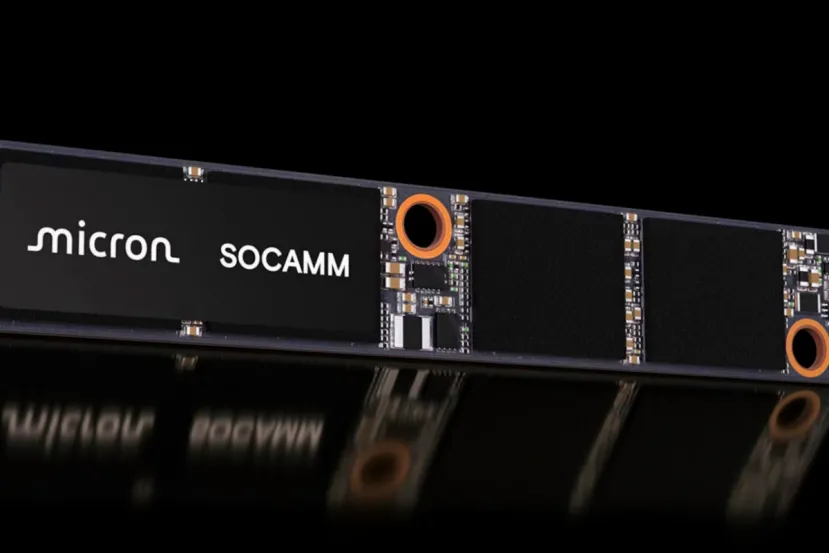

por Juan Antonio SotoHace ya algún tiempo que hemos visto nuevos módulos de memoria destinados a satisfacer la necesidad de memoria en equipos de alto rendimiento para IA, los SOCAMM. Unos módulos de memoria que cuentan con el apoyo de uno de los grandes como NVIDIA, y que parece se extenderán a multitud de sistemas para IA donde ofrecer sus ventajas como la escalabilidad. Aunque todavía no está muy extendida la primera versión SOCAMM, la JEDEC ya está terminando el estándar SOCAMM2 de próxima generación.

La JEDEC está terminando el estándar SOCAMM2

La memoria SOCAMM2 está destinada a ofrecer grandes cantidades de memoria en dispositivos de más reducido tamaño, como estaciones de trabajo similares a la nueva NVIDIA DGX Spark. Además, ofrecerá escalabilidad, con la posibilidad de reemplazar el módulo ocupando el mínimo espacio, para poder optar en un futuro a configuraciones de memoria más grandes.

Una de las grandes ventajas de SOCAMM2 es la escalabilidad

Está basada en la extendida memoria LPDDR5x con las ventajas de ser reemplazable, y ofrece un mayor ancho de banda ideal para aplicaciones de alto rendimiento como la tan demandada Inteligencia Artificial. Es capaz de ofrecer hasta 9,6 Gb/s por cada pin, lo que supone una gran velocidad en tareas de inferencia o IA, a la vez que reduce su consumo y ofrece una mejor temperatura que la memoria tradicional.

Hasta 9,6 Gb/s por cada pin en la SOCAMM2

Para poder asegurar un buen funcionamiento de la SOCAMM2, se ha introducido SPD (Serial Presence Detect), que cuenta con telemetría e identificación del módulo. Pronto estará definido este nuevo estándar que, presumiblemente, llegará para abordar los desafíos de incremento de memoria en dispositivos destinados a la IA, y donde cada vez es necesaria mayor cantidad.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!