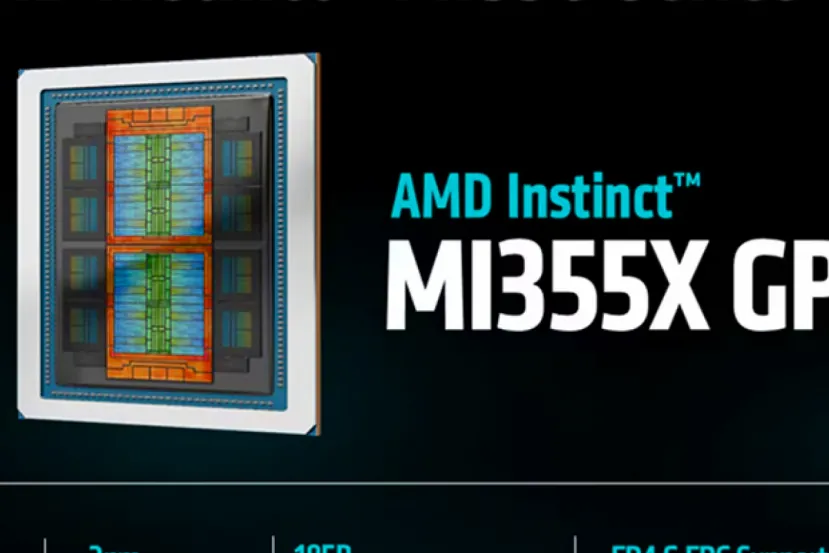

AMD rompe el millón de tokens por segundo con las Instinct MI355X y acelera la IA a gran escala

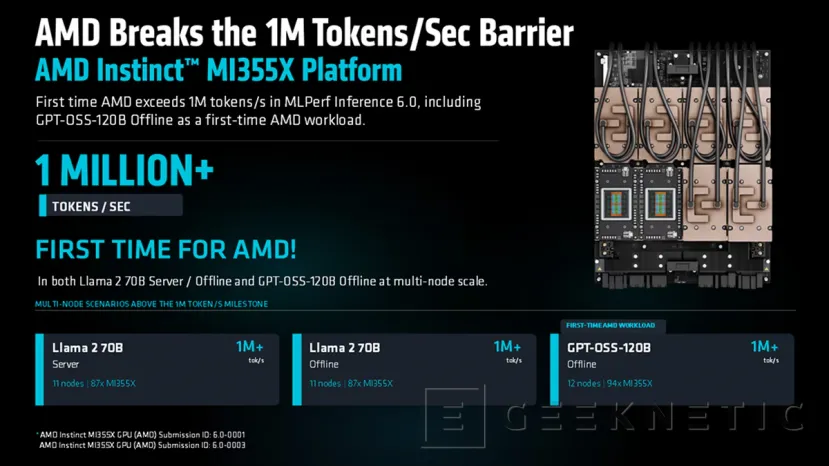

por Juan Antonio SotoAMD ha presentado sus resultados en MLPerf Inference 6.0, donde ha conseguido un hito clave para la industria de la inteligencia artificial: superar el millón de tokens por segundo en inferencia a escala multinodo. Lo ha hecho con sus nuevas AMD Instinct MI355X, unas GPUs diseñadas específicamente para cargas de IA que no solo buscan rendimiento bruto, sino también capacidad de escalado real en entornos de producción. Este movimiento refuerza la posición de AMD frente a sus competidores en un momento donde la inferencia es cada vez más crítica.

Más de 1 millón de tokens por segundo y salto generacional

Uno de los puntos más destacados es precisamente ese salto en rendimiento agregado. AMD ha logrado superar el millón de tokens por segundo en modelos como Llama 2 70B y GPT-OSS-120B, demostrando que su plataforma puede sostener cargas masivas cuando se distribuye en múltiples nodos. Este tipo de cifras ya no se quedan en pruebas aisladas, sino que apuntan directamente a escenarios reales donde el número de usuarios, el tamaño de los modelos y el tiempo de respuesta marcan la diferencia.

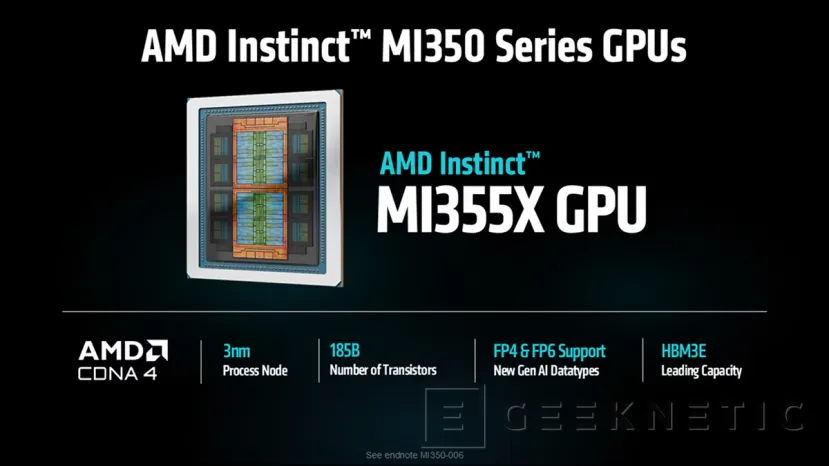

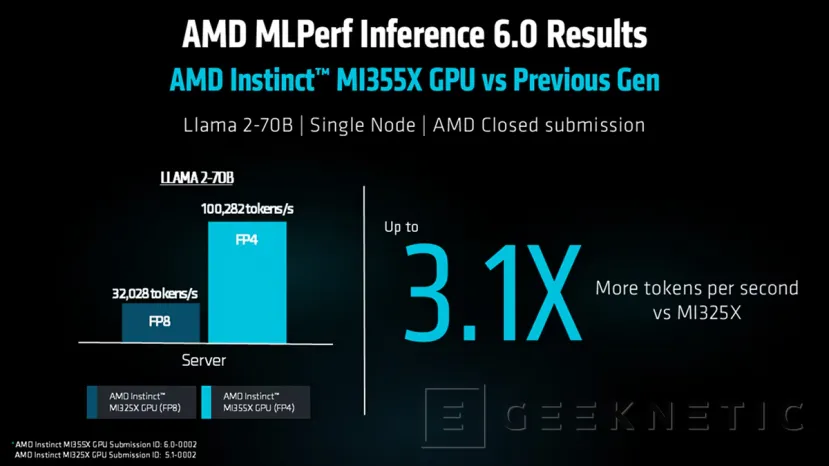

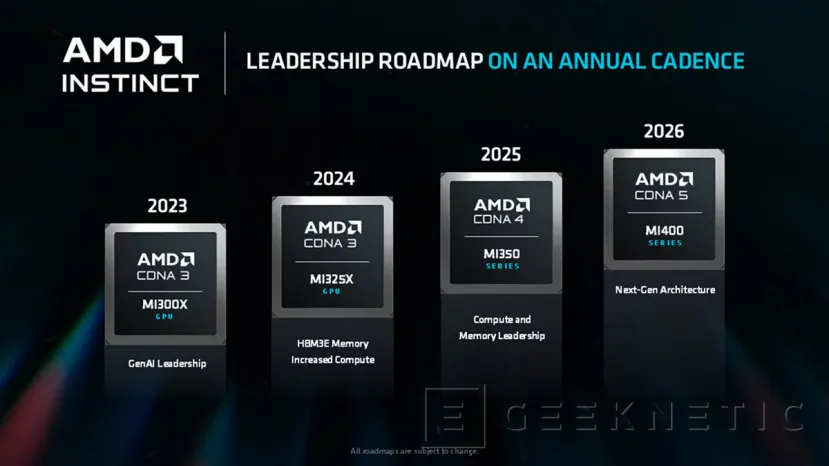

También hay un salto generacional importante respecto a la anterior arquitectura. La Instinct MI355X alcanza más de 100.000 tokens por segundo en pruebas de servidor, lo que supone hasta 3,1 veces más rendimiento que la MI325X en apenas unos meses. Este avance llega de la mano de la arquitectura CDNA 4, un proceso de 3 nm, soporte para nuevos formatos como FP4 y FP6 y grandes cantidades de memoria HBM3E, una configuración clave para mover modelos cada vez más grandes.

AMD planta cara a NVIDIA y se abre a nuevos modelos

En cuanto a la competencia, AMD ha dejado claro que ya no juega en una liga secundaria. En pruebas con Llama 2 70B, sus resultados se sitúan muy cerca de GPUs como las NVIDIA B200 y B300, alcanzando prácticamente la paridad en varios escenarios e incluso superando el rendimiento en determinadas pruebas. Más allá de una cifra concreta, lo importante es que AMD consigue mantenerse competitivo en diferentes tipos de carga, desde procesamiento por lotes hasta inferencia en tiempo real.

Otro aspecto interesante es la rapidez con la que AMD está adaptándose a nuevos modelos y cargas de trabajo. En esta edición de MLPerf ha incluido por primera vez GPT-OSS-120B, logrando resultados competitivos desde el primer intento, algo especialmente complejo en pruebas tan exigentes. Además, también ha dado el salto a la generación de vídeo con IA mediante Wan-2.2-t2v, dejando claro que su estrategia va más allá de los modelos de lenguaje tradicionales.

Escalado eficiente, ROCm y el futuro con MI400

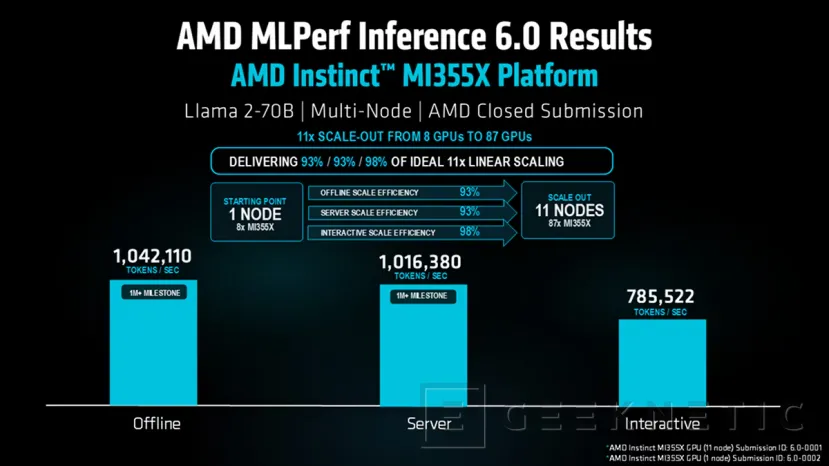

El escalado multinodo ha sido otro de los grandes protagonistas. AMD ha conseguido mantener una eficiencia cercana al 93% al pasar de un nodo a configuraciones de hasta 11 y 12 nodos, superando de nuevo el millón de tokens por segundo en varios escenarios. Este tipo de eficiencia es clave para centros de datos, ya que permite crecer en capacidad sin penalizar el rendimiento, algo fundamental cuando se trabaja con modelos cada vez más complejos.

Detrás de todos estos resultados está ROCm, el ecosistema software de AMD, que juega un papel clave en la optimización, el reparto de cargas y la comunicación entre GPUs. La compañía también ha destacado la consistencia de los resultados obtenidos por sus socios, con cifras muy similares entre diferentes fabricantes, lo que refuerza la idea de una plataforma bien optimizada y lista para desplegar en entornos reales.

Todo esto forma parte de una hoja de ruta que AMD está ejecutando con ritmo anual y que continuará con la llegada de la serie Instinct MI400, basada en CDNA 5, junto a soluciones a nivel de rack como Helios. Con estos avances, AMD no solo busca competir en pruebas, sino posicionarse como una alternativa sólida para la infraestructura de IA generativa a gran escala, donde el rendimiento, la eficiencia y la escalabilidad son igual de importantes.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!